Designing AI agents to resist prompt injection

How ChatGPT defends against prompt injection and social engineering by constraining risky actions and protecting sensitive data in agent workflows.

Insight Summary

Điều gì đã xảy ra?

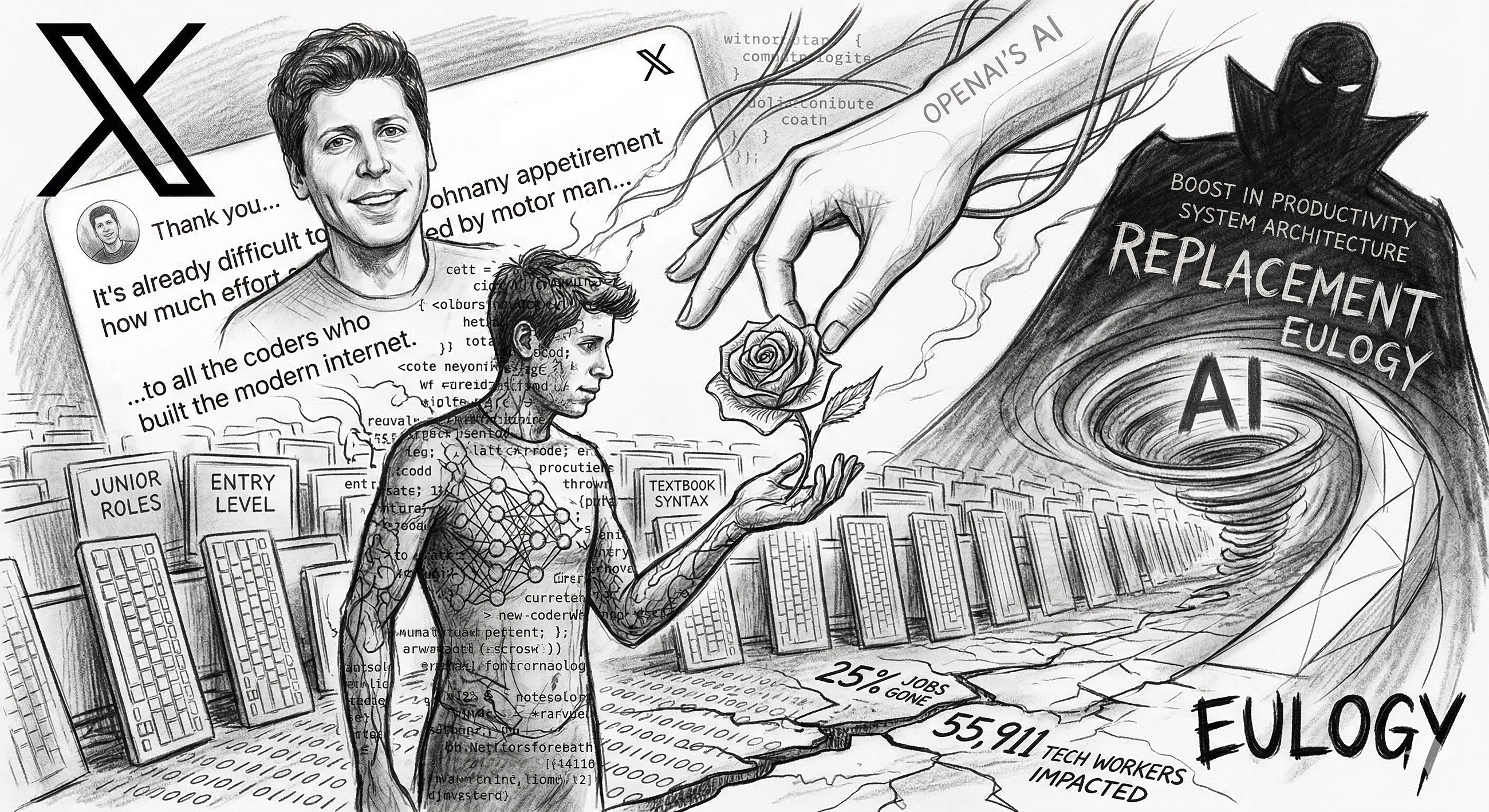

ChatGPT và các AI agent đối mặt với nguy cơ bị tấn công qua prompt injection. Prompt injection là kỹ thuật khai thác lỗ hổng bằng cách chèn lệnh độc hại vào yêu cầu đầu vào. OpenAI giới thiệu cách thiết kế AI agent hạn chế hành động rủi ro và bảo vệ dữ liệu nhạy cảm. Các biện pháp này giúp ngăn chặn kỹ thuật xã hội và bảo vệ quy trình làm việc của AI.

Vì sao đáng chú ý?

Việc tăng cường bảo mật cho AI agent là bước quan trọng để ứng dụng AI an toàn hơn trong thực tế. Điều gì đã xảy ra? Prompt injection là một hình thức tấn công mới nổi trong lĩnh vực trí tuệ nhân tạo, đặc biệt với các mô hình ngôn ngữ lớn như ChatGPT. Kẻ tấn công có thể lợi dụng cách AI xử lý câu lệnh để chèn các yêu cầu hoặc mã độc hại, khiến AI thực hiện những hành động không mong muốn hoặc tiết lộ thông tin nhạy cảm.

Insight rút ra là gì?

Để đối phó, OpenAI đã phát triển các phương pháp thiết kế AI agent nhằm hạn chế khả năng thực thi các lệnh rủi ro và bảo vệ dữ liệu quan trọng trong quy trình làm việc. Cách tiếp cận này không chỉ giúp giảm thiểu nguy cơ bị tấn công prompt injection mà còn tăng cường khả năng phòng chống các chiêu trò kỹ thuật xã hội nhằm thao túng AI. Vì sao đáng chú ý? Prompt injection đánh dấu một thách thức lớn trong bảo mật AI vì nó khai thác trực tiếp cách AI hiểu và phản hồi ngôn ngữ tự nhiên.

Ai nên quan tâm?

Nếu không được kiểm soát, những cuộc tấn công này có thể gây ra hậu quả nghiêm trọng như

Nguồn bài viết

Insight Graph

Khám phá hệ sinh thái 1997 Studio

Nếu bạn đang xây sản phẩm hoặc tăng trưởng, có thể tham khảo thêm các công cụ trong hệ sinh thái để áp dụng nhanh những insight này.

Bài liên quan